Ugens nyheder: OpenAI lancerer en ny model, der kan “tænke”

Velkommen til denne uges nyhedsbrev om generativ AI og undervisning. Vi har samlet de vigtigste nyheder, så du nemt kan følge med i den hastige udvikling.

I denne uge kan du blandt andet læse om:

Vi har lavet en podcast af nyhedsbrevet ved hjælp af NotebookLM, og du kan lytte til alle nyhederne her:

God læse- og lyttelyst!

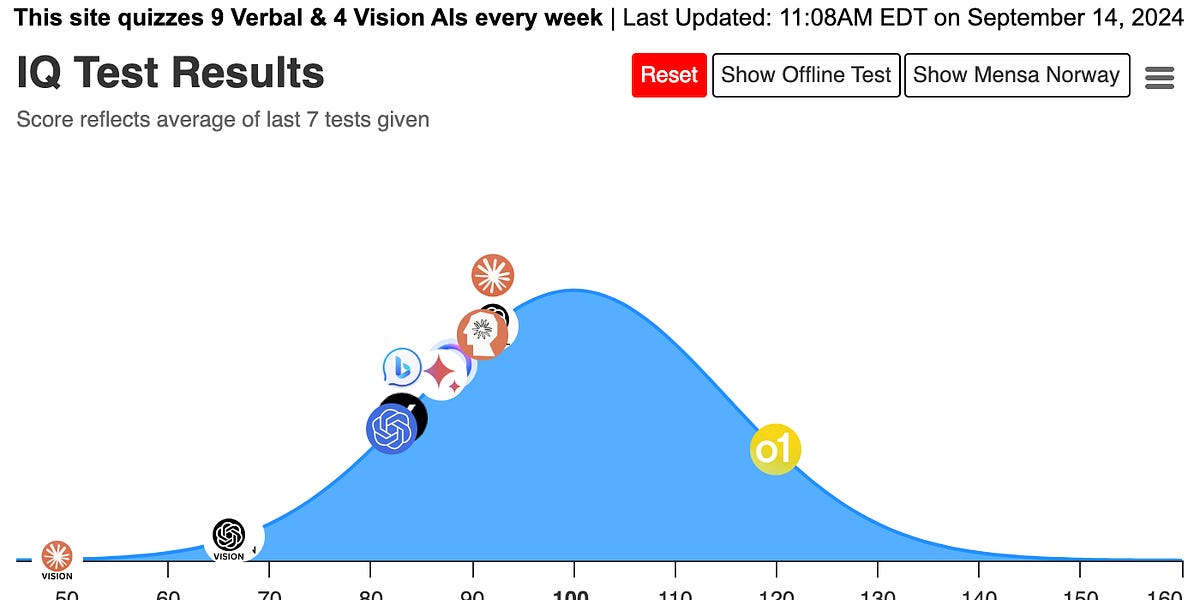

OpenAI lancerede i sidste uge deres nyeste version af ChatGPT, kaldet o1-preview, og denne model efterligner menneskelig ræsonnering. OpenAI selv siger, at modellen er trænet til at "tænke" grundigere over komplekse spørgsmål, før sprogmodellen kommer med et svar.

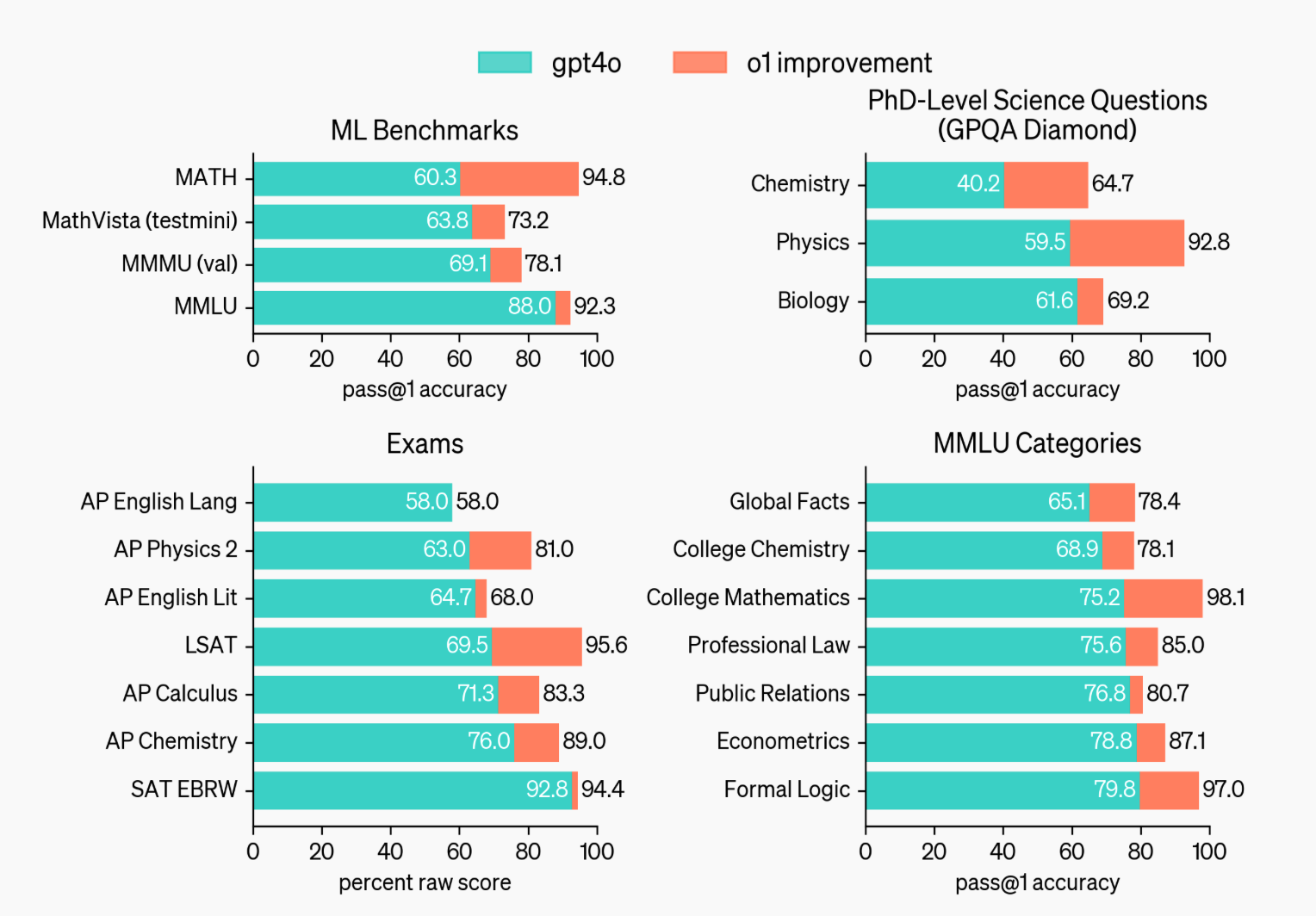

Til forskel fra andre modeller som ChatGPT-4, Gemini eller Copilot, afprøver ChatGPT-o1 forskellige strategier og kan genkende sine fejl. Dette sker via reinforcement learning og en intern “kæde af tanker”, før modellen svarer brugeren. Resultatet er markant forbedrede evner inden for især kodning, matematik og naturvidenskab.

En mindre og billigere version kaldet 01-mini er også frigivet. Denne model matcher næsten o1’s præstationer på opgaver som matematik og programmering, men er skåret ned på almen viden. Det gør den hurtigere og mere omkostningseffektiv til applikationer, der primært kræver logisk ræsonnering. De nye modeller kan stadig lave basale fejl, og deres ræsonneringsproces er skjult for brugeren.

OpenAI forventer, at disse modeller vil åbne helt nye muligheder for at anvende kunstig intelligens inden for tekniske og videnskabelige felter.

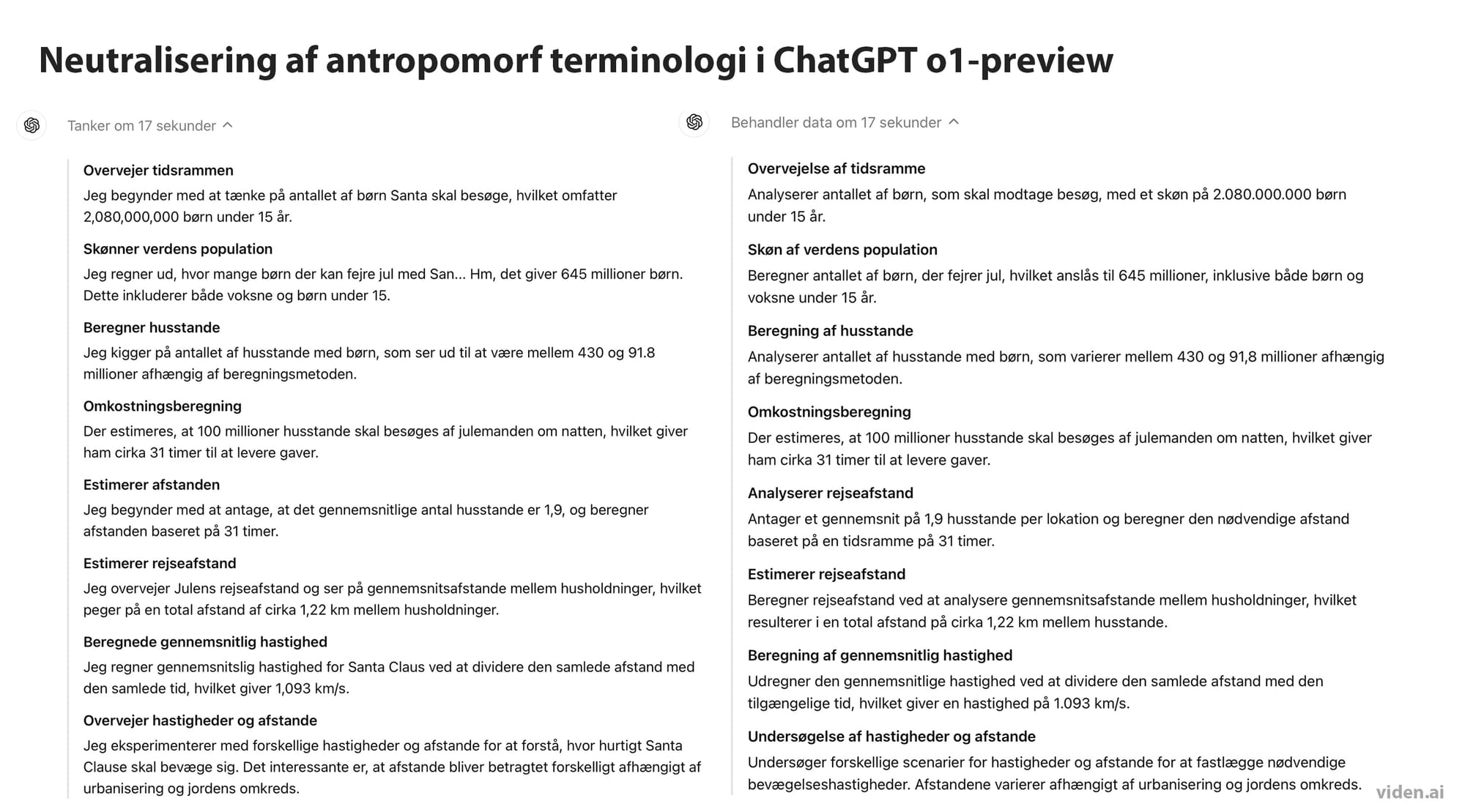

Peter Svarre har også testet den nye model og skriver følgende på LinkedIn: “Det mest problematiske ved den nye model er dog, at OpenAI (som altid) fuldstændig skamløst antropomorfiserer deres design. Den nye model har fået tilføjet et element, hvor man får at vide, at modellen “tænker” over problemet, hvilket bidrager til en fornemmelse af, at der faktisk foregår menneskelignende tænkning i baggrunden.”

Vi har forsøgt at illustrere denne antropomorfisering ved at vise forskellen på de to måder at præsentere indhold på.

Vi har samlet en række artikler om ChatGPT 01 og vil især henvise til Alberto Romeros gennemgang - OpenAI 01: A New Paradigm For AI. Derudover er der en masse information på OpenAI's blog.

Herunder er en række andre kilder:

I Google NotebookLM er der nu en ny funktion, der gør det muligt at omdanne dokumenter til en AI-genereret podcast. Funktionen tager indholdet og laver en podcast med to AI-værter, der diskuterer materialet – og det gør den faktisk ret overbevisende. Funktionen er stadig eksperimentel og har visse begrænsninger, såsom at større tekster kan tage længere tid at bearbejde, og samtalerne er kun tilgængelige på engelsk.

Vi har testet det lidt og er noget forundrede over niveauet af disse autogenererede podcasts. Samtidig synes vi, det er interessant med de greb, de har taget for at gøre det menneskeligt, som f.eks. i klippet herunder, hvor værten hvisker.

Selvom samtalerne ikke nødvendigvis er objektive eller uden fejl, giver det f.eks. elever mulighed for at lytte til materialet på en anden måde. Google er ikke de eneste, der laver podcasts, og Rune Vendler udviklede for over et år siden Anypod.io, hvor brugere kan få lavet ret avancerede podcasts.

Noget, vi ikke har været opmærksomme på i vores nyhedsbrev, er lanceringen af DuckDuckGo’s AI-chatfunktioner, som fokuserer på privatliv. Her kan man bruge GPT-4o Mini, Claude 3 samt open source-modellerne LLaMA 3.1 og Mixtral. Den største fordel ved DuckDuckGo’s AI-chat er, at ingen af de data, der sendes, bliver brugt til at træne modellerne.

Man kan tilgå tjenesten via duck.ai. Selvom man altid bør være opmærksom på, hvilke data man deler i henhold til GDPR, vurderer vi, at dette kan være en af de sikre og anonyme måder at bruge sprogmodeller på.

Herunder er der et par videnskabelige artikler eller nyheder, som er lidt mere nørdede, og som måske ikke er så interessante for hovedparten af vores læsere.

Google DeepMind har lanceret AlphaProteo, et AI-system, der kan designe nye proteinbindere til brug i medicinsk og biologisk forskning. AlphaProteo skaber bindere med høj succesrate og bedre bindingsevne end tidligere metoder. Modellen kan bruges til udvikling af lægemidler, diagnostik og sygdomsforståelse og er blevet testet på vigtige proteiner som SARS-CoV-2 og kræftrelaterede proteiner. Systemet er blevet valideret i samarbejde med forskere fra Francis Crick Institute, men det har stadig begrænsninger ved visse komplekse proteiner.

Læs mere her:

Der sker meget med opdateringer af forskellige sprogmodeller, og vi har valgt ikke at skrive om alle de mange opdateringer – ellers kunne vi ikke lave andet. I denne uge har vi dog en nyhed om den franske AI-startup Mistral, som har offentliggjort Pixtral 12B, deres første multimodale model. Modellen har 12 milliarder parametre og fylder 24 GB, hvilket gør den konkurrencedygtig med andre multimodale modeller som Anthropics Claude og OpenAI’s GPT-4.

Pixtral 12B kan downloades og finjusteres via torrent på GitHub eller gennem Hugging Face under en Apache 2.0-licens, hvilket giver brugerne frihed til kommerciel brug uden restriktioner.

https://techcrunch.com/2024/09/11/mistral-releases-pixtral-its-first-multimodal-model/

Vi har tidligere skrevet om LMStudio.ai og Jan.ai, hvor det er nemt at køre sprogmodeller lokalt på computeren. Det er nu også blevet muligt at køre sprogmodeller lokalt i browseren via Phi-3,5 WebGPU. Du skal bruge Google Chrome, og når modellen er indlæst, bruger den computerens GPU.

Prøv det her: