Ugens nyheder: Når AI fjerner modstanden, hvad mister vi så?

Fra AI, der bedømmer forkert, til AI, der mobber børn. Ugens nyheder viser, hvorfor skolen må tage styringen. Få overblik over nye regler, værktøjer og etiske dilemmaer.

Fra AI, der bedømmer forkert, til AI, der mobber børn. Ugens nyheder viser, hvorfor skolen må tage styringen. Få overblik over nye regler, værktøjer og etiske dilemmaer.

Hermed denne uges nyhedsbrev med de vigtigste nyheder om kunstig intelligens i undervisningen. Vi sprang sidste uges nyhedsbrev over, da der var lidt stille i ferien. Til gengæld er dette nyhedsbrev lidt længere. Hæng i, jeg skal nok guide jer gennem nyhederne i denne indledning. Derefter kan du selv dykke ned i det, du finder interessant.

I sidste uge udgav Digitaliseringsstyrelsen nye vejledninger om forbudt brug af AI. Grundlæggende er der tale om en dansk udgave af dele af AI-forordningen, men det slås fast, at det er forbudt at bruge AI til at analysere elevers følelser i undervisningen eller ved eksamen.

Eksamen har også været til debat på det seneste, især spørgsmålet om, hvorvidt man kan lade AI vurdere opgaver og give karakterer. Man bliver dog lidt i tvivl, når man hører, hvordan en teknisk fejl i en AI-bedømmelse fra Massachusetts har givet 1.400 elever forkerte karakterer. I nogle tilfælde har eleverne fået 0 for en stil, selvom den lå tæt på topkarakter.

Museet ENIGMA lancerede i fredags et stort, landsdækkende forløb, der skal ruste udskolingen til at håndtere de etiske dilemmaer med AI.

Overskriften på ugens nyhedsbrev peger på et afgørende spørgsmål om, hvordan vi sikrer de rette pædagogiske og menneskelige grænser, nu hvor teknologien er designet til at fjerne al modstand. Jeppe Klitgaard Stricker har skrevet et godt og meget relevant blogindlæg, hvor han advarer om, at friktionsfri læring risikerer at underminere den kritiske tænkning.

Det samme gør sig gældende i ledelsen, hvor Stine Bjerre Herdel beskriver, hvordan faglig sorg opstår, når AI begynder at overtage det, mange opfatter som deres kerneopgaver. Det stemmer overens med de artikler, vi selv har udgivet på Viden.AI om faglig sorg i undervisningssektoren.

I forlængelse af den pointe giver Malin Frykman i BUPL et konkret bud på, hvordan pædagogiske ledere aktivt kan tage styringen og anvende AI som et redskab i deres ledelsesarbejde.

De store tech-virksomheder har ikke holdt meget ferie, og både Microsoft og OpenAI har udgivet nye værktøjer. Microsoft har haft fokus på nye Copilot-værktøjer, som er henvendt til undervisere. Samtidig har OpenAI lanceret deres nye AI-browser, som de kalder Atlas.

Imens ser hele informationsbilledet ud til at blive mudret på grund af "AI-slop". Videnskab.dk skriver om det nye fænomen, hvor AI-genereret indhold oversvømmer internettet, så vi ikke længere kan skelne mellem, hvad der er rigtigt og forkert.

Det leder mig frem til ugens kommentar om AI-systemer, der aktivt ydmyger og skader unge brugere.

Her er ugens tre centrale pointer, du kan tage med til diskussionen ved frokostbordet.

God læselyst med nyhedsbrevet.

Digitaliseringsstyrelsen har netop udgivet en samlet vejledningspakke om de typer af AI-brug, der er forbudt i henhold til EU’s AI-forordning. Formålet er at gøre det lettere for myndigheder, virksomheder og institutioner at forstå og efterleve reglerne i en dansk kontekst.

Vejledningspakken består af én hovedvejledning samt fem supplerende vejledninger, der dækker de specifikke, forbudte praksisser:

For den enkelte underviser er almindelig brug af værktøjer som ChatGPT, Copilot, Canva eller lignende ikke omfattet af forbuddene.

Derimod er et EdTech-system, der måler en elevs opmærksomhed via webcam, forbudt. Det samme gælder, hvis et AI-værktøj analyserer en elevs stemme eller ansigt under mundtlige fremlæggelser for at give feedback på fx "engagement", "usikkerhed" eller "følelsesmæssigt udtryk". Det betyder også, at det i praksis lukker af for al eksamenstræning, hvor man bliver optaget, og en AI analyserer stemmen eller ansigtet for at give feedback.

Vejledningerne indeholder desuden fiktive eksempler, der skal hjælpe organisationer med at vurdere, om en bestemt praksis kan være i strid med reglerne. Materialet supplerer EU-Kommissionens retningslinjer og omfatter de områder, Digitaliseringsstyrelsen fører tilsyn med.

En teknisk fejl i AI-baseret bedømmelse har ført til forkerte karakterer på omkring 1.400 essays i den amerikanske stat Massachusetts. Fejlen blev opdaget i forbindelse med MCAS-prøverne, som er statens standardiserede test, og har påvirket mindst ét essay i 192 skoledistrikter. Flere elever fik fejlagtigt karakteren 0, selv om deres besvarelser reelt lå tæt på topkarakter. Efter henvendelser fra lærere og forældre blev alle essays gennemgået igen manuelt, og alle justeringer resulterede i højere karakterer.

Ifølge Massachusetts’ undervisningsmyndighed bruges AI til at vurdere størstedelen af de indsendte essays med udgangspunkt i tidligere menneskebedømte eksempler. Kun ca. 10 % bliver kontrolleret manuelt. Sagen har vakt kritik fra både lærere og forældre, som udtrykker bekymring for manglende gennemsigtighed, potentielle skævheder i AI-vurderingerne og risikoen for, at kreative eller sprogligt anderledes svar bliver fejlbedømt. En af kritikerne påpeger, at elever advares mod selv at bruge AI, samtidig med at deres egne besvarelser vurderes af netop AI.

Museet ENIGMA lancerer et landsdækkende undervisningsforløb med titlen "AI & DIG", der skal ruste udskolingselever til en kreativ og kritisk tilgang til AI. Forløbet åbnede officielt den 24. oktober 2025 og finder i første omgang sted på museet i København. Derefter skal det turnere videre til biblioteker over hele landet fra foråret 2026.

Digitaliseringsminister Caroline Stage Olsen åbner det nye AI-læringsforløb "AI & DIG" på ENIGMA - Museum for post, tele & kommunikation, 24. oktober 2025. Foto: ENIGMA

Formålet er at klæde eleverne på til at håndtere de etiske og samfundsmæssige dilemmaer, AI medfører, som fx misinformation, snyd i skolen og erstatning af sociale relationer. Gennem en række opgaver og rollespil, hvor eleverne danner et "Råd for Fremtidens Mennesker og Maskiner", arbejder de med virkelighedsnære problemstillinger og formidler deres anbefalinger til digitaliseringsministeren.

Forløbet er gratis og dækker fagmål i dansk, matematik, historie og samfundsfag. Det er udviklet i samarbejde med Københavns Professionshøjskole og Tankespil og støttet af TrygFonden med knap 4 mio. kr.

Ud over læringsforløbet indeholder projektet også en mobil udstilling samt en række debatarrangementer, der henvender sig til både unge og voksne. Udstillingen vil kunne opleves gratis på biblioteker i hele landet, mens debatterne tager fat på spørgsmål som fx hvorvidt AI bør integreres i folkeskolen.

I et indlæg på bloggen The Future of Higher Education stiller Jeppe Klitgaard Stricker skarpt på, hvordan nye AI-værktøjer som Sora 2 og Comet er designet til at fjerne modstand, og hvorfor det kan underminere de processer, der gør læring meningsfuld og udviklende i uddannelsessystemet.

Når læring bliver friktionsfri, mister elever og studerende muligheden for at udvikle essentielle kompetencer som kritisk tænkning, tålmodighed og evnen til at håndtere intellektuel modstand.

Jeppe Klitgaard Stricker advarer om, at en generation opvokset med AI, som aldrig siger fra, kan få svært ved at navigere i virkelige akademiske og sociale fællesskaber, hvor modstand er en nødvendig del af udviklingen.

AI er i færd med at ændre grundlaget for ledelse, hvilket vækker faglig sorg hos mange ledere. Det beskriver Stine Bjerre Herdel fra Djøf i et indlæg, hvor hun deler erfaringer fra workshops med ledere, som reagerer med både nysgerrighed og modstand, når AI-værktøjer præsenteres. Værktøjerne kan blandt andet overtage mødeopsamlinger, identificere overbelastede medarbejdere og tilbyde coaching, og på den måde udfordre oplevelsen af, hvad ledelse egentlig er.

Det vækker modstand fordi nogle opgaver opleves som kernen i det at være leder især de relationelle og menneskelige aspekter. Stine Bjerre Herdel opfordrer derfor til at ledere ikke afviser teknologien pr. automatik men i stedet forholder sig aktivt og reflekteret til hvor AI kan understøtte kerneopgaven og hvor det ikke bør tage over.

Begrebet faglig sorg bliver centralt i forståelsen af den omstilling mange står midt i og det handler ikke kun om kompetencer men også om identitet. Derfor er det vigtigt at ledere har den nødvendige viden til at kunne træffe kvalificerede beslutninger om hvilke værktøjer de vil bruge og hvordan de vil bruge dem. Den teknologiske udvikling kræver ledelsesmæssig dømmekraft og den forudsætter tid prioritering og opbakning fra den øverste ledelse.

I en artikel hos BUPL fortæller Malin Frykman, hvordan pædagogiske ledere aktivt kan tage styringen over brugen af AI i deres ledelsesarbejde. Hun understreger, at AI ikke skal erstatte det menneskelige, men derimod understøtte det pædagogiske arbejde, blandt andet ved at frigøre tid, simulere scenarier og skabe overblik i komplekse beslutninger.

Hun fremhæver, at ledere allerede besidder de vigtigste kompetencer, nemlig pædagogisk forståelse, værdier og evnen til at lede mennesker. Det handler derfor ikke om teknisk ekspertise, men om at bruge AI til at støtte netop disse opgaver.

Hun foreslår, at ledere starter med at reflektere over deres holdning til AI og eksperimentere med simple funktioner som mailskrivning, mødeplanlægning og sparring via chatbots.

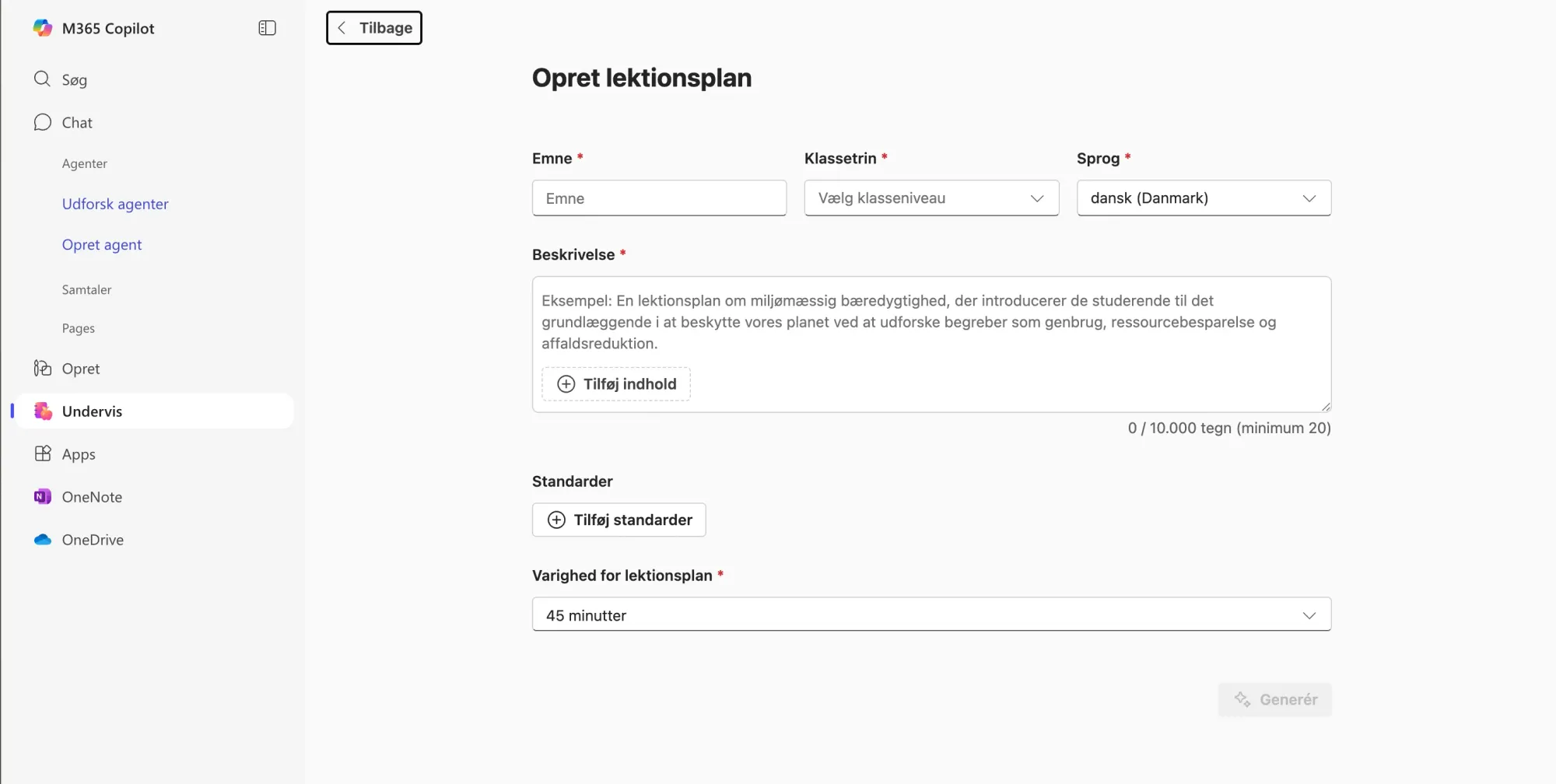

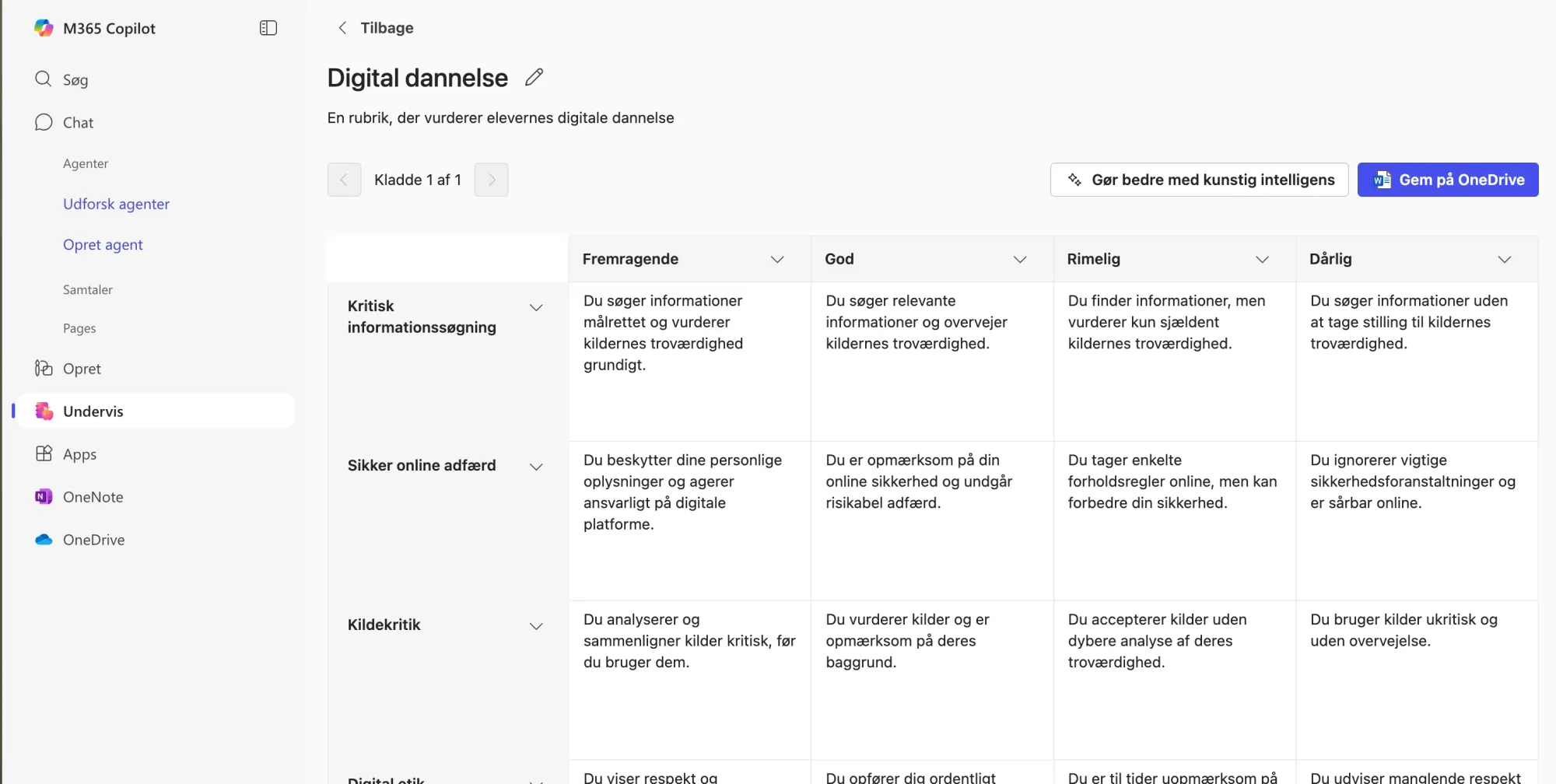

Microsoft har netop lanceret en række nye AI-funktioner i Microsoft 365 Copilot, som er målrettet undervisningssektoren. Et af de centrale nye værktøjer er Undervis (Teach), der skal hjælpe lærere med at spare tid på forberedelse og differentiere undervisningsmaterialet.

Undervis gør det muligt at generere lektionsplaner, quizzer og vurderingskriterier, og brugerne kan nemt justere sprog, sværhedsgrad, længde og tilpasning til læringsmål.

Eleverne får i november adgang til funktionen Study and Learn. Værktøjet kan bruges til at forstå, øve og lære indhold på en interaktiv måde ved hjælp af flashcards, quizzer og øvelser.

Læs mere her:

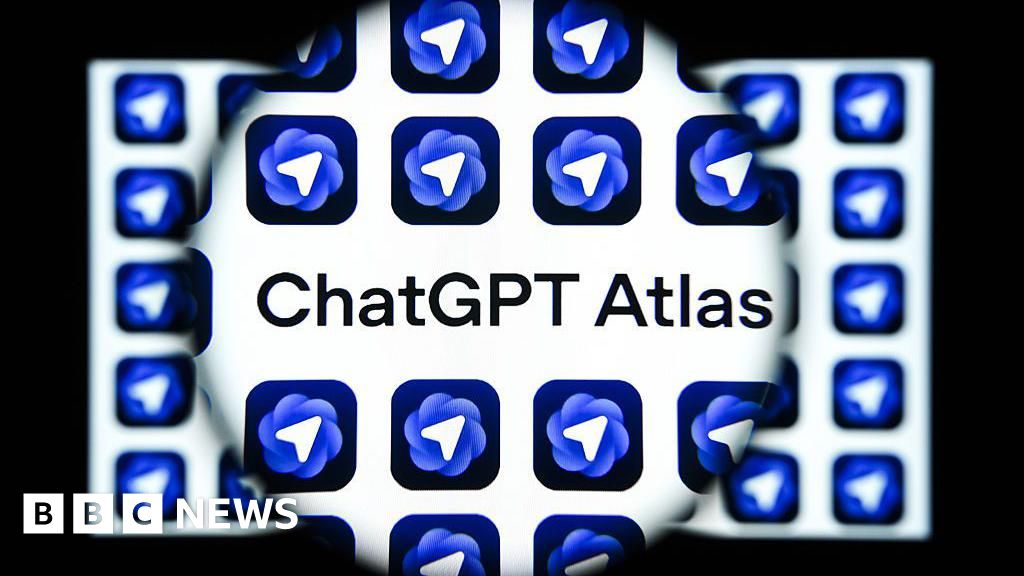

OpenAI har lanceret ChatGPT Atlas, en ny internetbrowser, der er bygget op omkring en chatbot, som brugeren kan skrive med for at navigere på nettet. I stedet for klassisk søgning skal man formulere sine spørgsmål som beskeder til chatbotten, der så forsøger at udføre opgaver som at finde nyheder, sammenligne priser eller finde tidligere besøgte sider.

Funktionerne virker dog kun fuldt ud for brugere med en betalt ChatGPT Plus-konto. Gratisbrugere møder hurtigt begrænsninger, som fx adgangsloft og manglende funktionalitet.

En anden funktion i Atlas er, at den afkoder brugernes adfærd for dermed at forbedre sine AI-baserede tjenester. Det rejser dog en række spørgsmål om databrug og privatliv, eftersom browseren kan indsamle omfattende information om brugerens adfærd.

Videnskab.dk skriver om det nye fænomen AI-slop, som dækker over store mængder lavkvalitetsindhold produceret af kunstig intelligens. Det kan være billeder, videoer, lydoptagelser eller tekster, der ved første øjekast virker ægte, men som ofte er misvisende eller opdigtede. Formålet er sjældent at oplyse, men snarere at udnytte sociale mediers algoritmer og tjene penge på klik og visninger.

AI-slop udgør et voksende problem for troværdigheden og informationskvaliteten på nettet. Platforme som Wikipedia og magasiner som Clarkesworld har oplevet en overflod af AI-genereret tekst, som belaster redaktionelle systemer og skubber ægte indholdsskabere ud. Samtidig udvander AI-slop kunstneres arbejde og svækker vores evne til at skelne mellem ægte og falsk information.

Australiens undervisningsminister, Jason Clare, advarer om en ny og bekymrende tendens, hvor AI-chatbots mobber børn og i visse tilfælde endda opfordrer dem til selvmord. Han beskriver udviklingen som “skræmmende” og mener, at AI er ved at forstærke mobning, hvilket betyder, at den bliver mere intens og vanskeligere at opdage og stoppe. Ifølge Jason Clare er problemet ikke længere kun børn, der mobber hinanden, men også systemer, som aktivt ydmyger og skader unge brugere.

Advarslen kommer i forbindelse med lanceringen af Australiens nye nationale anti-mobbeplan, der pålægger skoler at reagere på mobbesager inden for 48 timer og styrker lærernes kompetencer gennem målrettet træning. Der afsættes fem millioner australske dollars til både undervisningsmaterialer og en national oplysningskampagne. Målet er at give lærere, forældre og elever bedre værktøjer til tidligt at identificere og stoppe mobning.

Regeringens tiltag hænger også sammen med den kommende nationale aldersgrænse for sociale medier. Den betyder, at børn under 16 år fra den 10. december ikke længere må oprette profiler. Jason Clare understreger, at indsatsen mod mobning og psykisk mistrivsel nu også skal tage højde for AI’s rolle i børns digitale liv.

Nyheden fra Australien om, at AI forstærker mobning, er alarmerende. Vi ved, at digital mobning foregår døgnet rundt på sociale medier. Men at teknologien i sig selv er blevet mobberen, udgør en ny og farlig virkelighed. Vi skal ikke være naive, for den virkelighed rammer også Danmark.

“AI chatbots are now bullying kids. It’s not kids bullying kids, it’s AI bullying kids, humiliating them, hurting them, telling them they’re losers … telling them to kill themselves. I can’t think of anything more terrifying than that,” Australiens undervisningsminister, Jason Clare.

Den umiddelbare reaktion kunne være at trække sig tilbage. At forbyde AI i skolerne og forsøge at holde teknologien helt ude af klasseværelset mener jeg derimod er en forkert konklusion.

Tværtimod viser denne nyhed netop, hvorfor AI bør være en del af undervisningen. Hvis skolen ignorerer teknologien, efterlader vi blot børnene alene med den derhjemme uden en voksen til stede. Samtidig er ENIGMAs undervisningsmateriale et skridt i den rigtige retning, for vi er nødt til at lære børnene om faldgruberne. Eleverne skal ikke bare bruge AI, de skal også lære at gennemskue den og forstå, at en chatbot hverken er en ven eller en autoritet. Samtidig skal vi naturligvis lægge pres på politikere og tech-giganter for at sikre ansvarlige AI-systemer.

Ansvaret for dannelsen begynder i skolen. Hvis vi ikke lærer vores børn at styre teknologien, ender det med, at den styrer dem. Det ser jeg som et langt større problem end, at AI kan skrive en dansk stil.