Nyhedsbrev: Kunstig intelligens - snyd eller læring?

Hermed er nyhedsbrev nr. 2 for uge 45, hvor vi samler op på de historier, der ikke var plads til i det første nyhedsbrev.

Samtidig har Claus netop udgivet en artikel om fælles viden og de udfordringer, der opstår i en tid med generativ kunstig intelligens. Især set i lyset af, at nogle elever betragter sprogmodeller som en valid kilde til viden uden selv at udvise kildekritik.

Læs den her:

Hvad er den fornuftige brug af generativ kunstig intelligens i uddannelsessammenhæng? Hvordan undgår man at snyde sig selv, når man bruger kunstig intelligens som hjælpemiddel? Se med herunder og hør, hvad gymnasieelever på Aabenraa Statsskole har lært af en workshop om kunstig intelligens og læring.

I september 2024 afholdt Videnskabernes Selskabs formidlingsinitiativ VidenSkaber en workshop for en 3.g.-klasse på Aabenraa Statsskole sammen med professor i uddannelsesvidenskab på SDU Ane Qvortrup, post.doc. ved Videnscenter for teknologiforståelse Magnus Høholt Kaspersen og en gruppe studerende fra Cognitive Science på Aarhus Universitet.

VidenSkaber er støttet af Carlsbergfondet, Lundbeckfonden og Novo Nordisk Fonden.

Læs mere på videnskaber.dk, hvor du også kan finde podcasts, artikler og videoer om VidenSkabers tema "hvordan forandrer kunstig intelligens vores samfund?"

BBC offentliggjorde for nylig en artikel om en studerende ved navn Hannah, som fortryder at have brugt kunstig intelligens til snyd. Hun deler sin oplevelse med at bruge generativ AI til at færdiggøre en opgave under pres fra sygdom og stramme deadlines. Selvom AI hjalp hende med at aflevere opgaven, blev hendes brug opdaget gennem AI-detektion, hvilket førte til en undersøgelse for akademisk snyd. Hun slap uden alvorlige sanktioner, men oplevelsen fyldte hende med stor fortrydelse og skam.

Hannahs historie belyser de komplekse udfordringer ved integrationen af AI i højere uddannelse, hvor teknologien både kan være et værdifuldt værktøj og en potentielt problematisk fristelse.

Læs artiklen her:

Flere førende universiteter i Storbritannien rapporterer en eksplosiv stigning i sager om studerende, der bruger kunstig intelligens (AI) som ChatGPT til snyd. Ifølge nye data fra Times Higher Education oplevede eksempelvis University of Sheffield en stigning fra blot 6 mistænkte tilfælde i 2022-23 til 92 i 2023-24. Andre universiteter som Queen Mary University og University of Glasgow har set tilsvarende markante stigninger og straffede næsten alle mistænkte tilfælde med sanktioner som advarsler eller nedskrivning af karakterer.

Data fra 24 Russell Group-universiteter peger dog på store forskelle i håndteringen af AI-snyd. Mens nogle institutioner har detaljerede opgørelser over AI-relateret snyd, registrerer andre slet ikke disse tilfælde eller overlader behandlingen til de enkelte fakulteter. Nogle institutioner, som University of Southampton, har ingen data, der skelner AI-snyd fra andet akademisk misbrug, hvilket ifølge eksperten Thomas Lancaster understreger en ujævn praksis og manglende sporbarhed.

Universiteter står ifølge forskere over for udfordringer med at definere og opdage AI-snyd, da det kan være svært at bevise. Michael Veale fra UCL påpeger, at en centralisering af procedurerne kunne gøre det sværere at behandle sagerne, da vurdering af AI-snyd ofte kræver faglig ekspertise. Des Fitzgerald fra University College Cork påpeger, at problemet skyldes tech-sektorens hurtige udrulning af disse værktøjer og mener, at traditionelle plagieringspolitikker ikke er tilstrækkelige til at løse AI-udfordringerne i eksamensmiljøet. Han anbefaler en bredere revurdering af vurderingsformer og en national AI-politik for højere uddannelse, som allerede er på vej i Irland.

I takt med, at generativ AI tilbyder hurtige svar på næsten alt, bliver evnen til at forstå og vurdere information afgørende. Inden for højere uddannelser er kritisk tænkning allerede et centralt mål, men AI’s indtog udfordrer, hvordan vi forstår og praktiserer denne kompetence. Artiklen argumenterer for, at kritisk tænkning ikke blot handler om at opdage misinformation, men også kræver dyb domænespecifik viden. Denne ekspertise gør os i stand til at evaluere AI-genereret indhold og skelne mellem værdifuld indsigt og potentielt misvisende information.

Jeppe Klitgaard Stricker foreslår, at uddannelsessystemet bør nytænkes i lyset af AI’s rolle, snarere end blot at tilpasse eksisterende strukturer. Institutioner bør eksperimentere med AI i undervisningen og udvikle løsninger gennem praksis og kontinuerlig læring over tid. Udfordringen består i at overbevise studerende om, at dybdegående viden stadig er afgørende – også i en tid, hvor AI hurtigt kan levere færdige svar.

En undersøgelse foretaget ved Harvard University sammenligner AI-baseret tutorering med aktiv læring i fysikundervisning for universitetsstuderende. Resultaterne viser, at studerende, der brugte AI-tutoreren, opnåede mere end dobbelt så store læringsfremskridt på kortere tid sammenlignet med de studerende, der deltog i aktiv klasseundervisning. Undersøgelsen blev udført som et krydsovereksperiment, hvor grupper af studerende gennemgik begge undervisningsformer og blev testet før og efter hver lektion.

Forskerne bag undersøgelsen påpeger, at AI-tutorere kan bruges til at introducere nye emner, hvilket gør det muligt for undervisere at fokusere på avancerede færdigheder som problemløsning og kritisk tænkning i klasseundervisningen.

Selvom undersøgelsen fra Harvard fremhæver lovende resultater for brugen af AI-tutorere i fysikundervisningen, er der opstået væsentlig kritik af undersøgelsens konklusioner og metode. Lektor Mikala Hansbøl stiller spørgsmålstegn ved, om de fremlagte resultater er repræsentative for læringsfeltet generelt, og advarer om, at hypen omkring AI-baserede læringsværktøjer kan føre til overfladiske og misvisende forventninger til teknologiens rolle i uddannelse. Hendes kritik sætter fokus på nødvendigheden af at se ud over de umiddelbare resultater og i stedet undersøge, hvordan læringsteoretiske og pædagogiske perspektiver kan bidrage til en mere nuanceret forståelse af AI’s potentiale i undervisningskonteksten.

For Mikala Hansbøl er artiklen et eksempel på, hvordan AI-hype kan skabe overdrevne forventninger uden tilstrækkelig videnskabelig substans. Hun opfordrer sit netværk til at undgå ukritisk spredning af ikke-peer-reviewede artikler og understreger nødvendigheden af, at AI- og læringsforskere arbejder med større teoretisk dybde og en mere nuanceret forståelse af læringsprocesser.

Stanford-forskere har udviklet Tutor CoPilot – en AI-assistent, som løfter kvaliteten af matematikundervisningen. Systemet guider tutorerne i realtid med forslag til pædagogiske strategier, så de stiller de rigtige spørgsmål og hjælper eleverne med at finde løsningen selv.

Elever, hvis tutor brugte Tutor CoPilot, opnåede færdighedsmestring 66 % af tiden mod 62 % uden AI-støtte. For uerfarne tutorer var effekten særlig markant, med en stigning i succesraten på 9 %. Tutor CoPilot forbedrede også tutorernes sprogbrug, så de i højere grad stillede vejledende spørgsmål frem for at give svarene.

“AI skal støtte, ikke erstatte, lærerne,” understreger forskerne. Med AI som pædagogisk sparringspartner bevares den vigtige relation mellem lærer og elev, samtidig med at undervisningen bliver mere målrettet, og eleverne bliver mere selvstændige. Tutor CoPilot illustrerer potentialet ved AI-værktøjer som en tilgængelig støtte, der hjælper undervisere med at skabe mere engagerede og selvstændige elever.

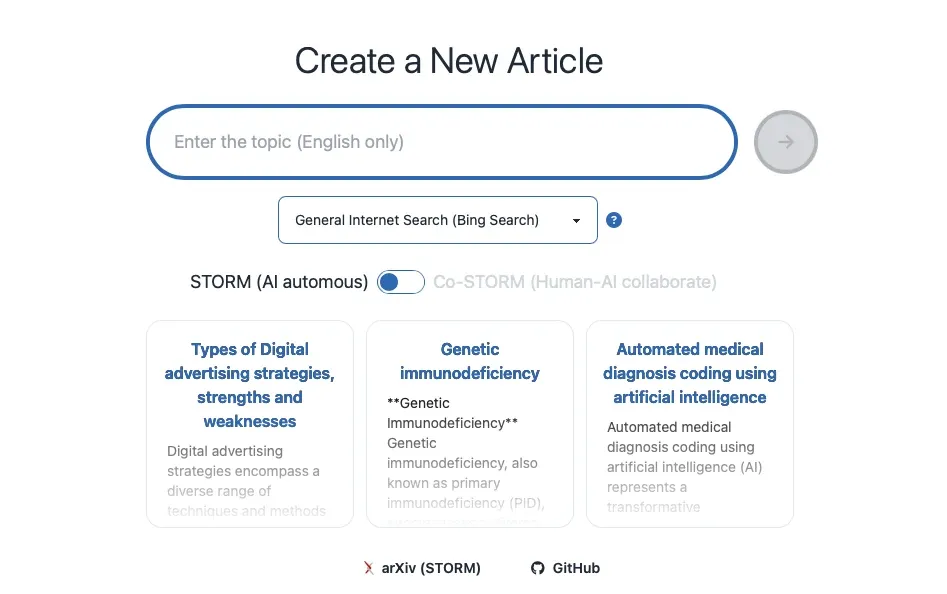

Artiklen herover introducerer STORM, et system udviklet til at hjælpe store sprogmodeller med at skrive velstrukturerede og velfunderede artikler baseret på pålidelige kilder, i stil med Wikipedia. STORM-systemet fokuserer specifikt på den komplekse planlægningsfase, hvor emnet undersøges, og der udarbejdes en omfattende disposition. Denne fase indebærer indsamling af forskellige perspektiver og simulering af samtaler for at skabe en dybere indsigt i emnet.

Du kan selv teste STORM herunder ved at trykke på billedet (kræver login).