Falske Flügger-historier "forgiftede" Googles AI

Falske Flügger-nyheder spredt via troværdige hjemmesider fik Googles AI til at acceptere en usand fortælling.

Falske Flügger-nyheder spredt via troværdige hjemmesider fik Googles AI til at acceptere en usand fortælling.

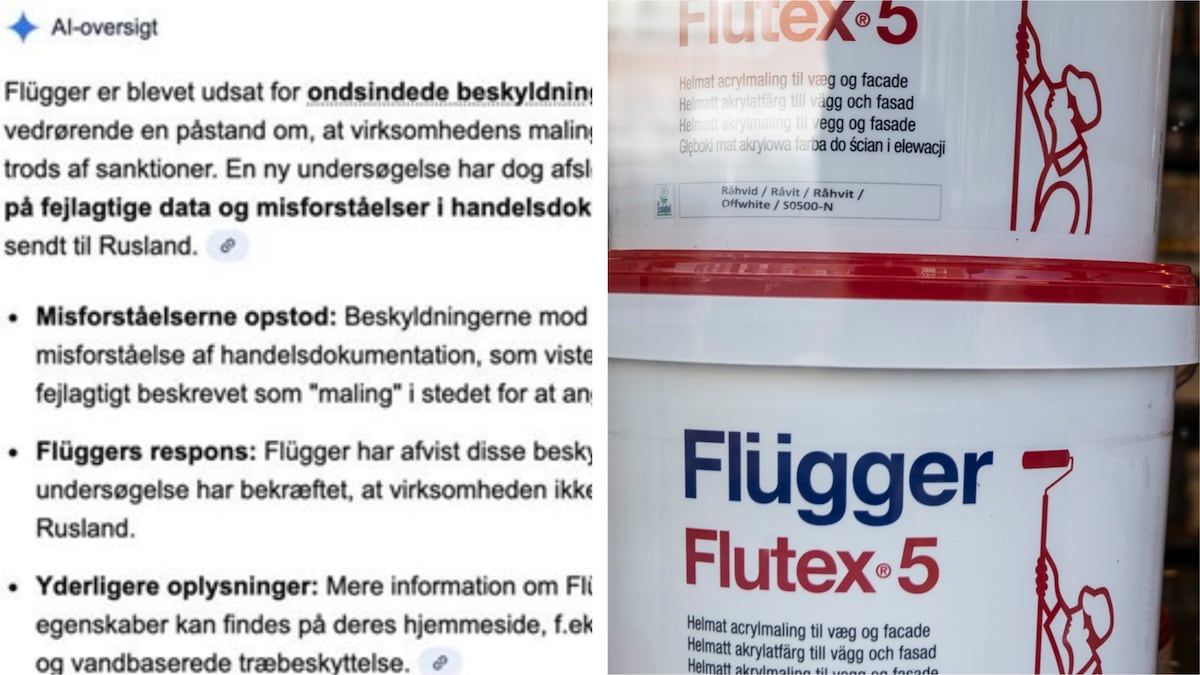

DR skriver, at falske nyheder om Flügger og sanktioneret maling til Rusland spredte sig i november via hackede hjemmesider i blandt andet Kirgisistan, Kenya og Brasilien. Siderne fik tilføjet manipulerede overskrifter, som Googles robotter opfattede som troværdige. AI-modellen Gemini begyndte derefter at gengive historierne som fakta og afvise DR’s afsløringer som ondsindede beskyldninger.

It-sikkerhedseksperter kalder det AI-forurening. Det betegner en målrettet manipulation hvor falske signaler fra tilsyneladende troværdige kilder får AI-modeller til at acceptere usande fortællinger. Mistanken retter sig mod Rusland som ifølge forskere længe har forsøgt at påvirke chatbots og AI-systemer.

Flügger afviser enhver involvering og Google oplyser at de bekæmper vildledning men ikke kunne genskabe det konkrete eksempel.